المقدمة

يمكن تشغيل Claude Code محليًا بالكامل دون الاعتماد على السحابة أو دفع أي تكاليف. العملية تعتمد على تشغيل نموذج ذكاء اصطناعي على جهازك وربطه بـ Claude ليعمل كواجهة ذكية لإدارة الكود وتنفيذه.

الخطوة 1: اختيار “العقل” المحلي (Ollama)

أولًا تحتاج إلى محرك محلي قادر على تشغيل نماذج الذكاء الاصطناعي والتعامل مع الأوامر البرمجية.

- قم بتحميل Ollama من:

http://ollama.com - بعد التثبيت:

- يعمل تلقائيًا في الخلفية على Mac وWindows

- يتم إضافته إلى مسار النظام (System Path)

- لا يحتاج تشغيل يدوي في كل مرة

- للتحقق من أنه يعمل:

- يتم تشغيله كخدمة خلفية

- يمكن الوصول إليه عبر:

http://localhost:1143

الخطوة 2: اختيار النموذج المناسب لجهازك

يجب اختيار نموذج بناءً على قوة جهازك:

- أجهزة قوية:

qwen3-coder:30b

- أجهزة متوسطة أو ضعيفة:

gemma:2bqwen2.5-coder:7b

بعد اختيار النموذج:

- افتح Terminal

- ابدأ تحميل النموذج باستخدام الأمر المناسب

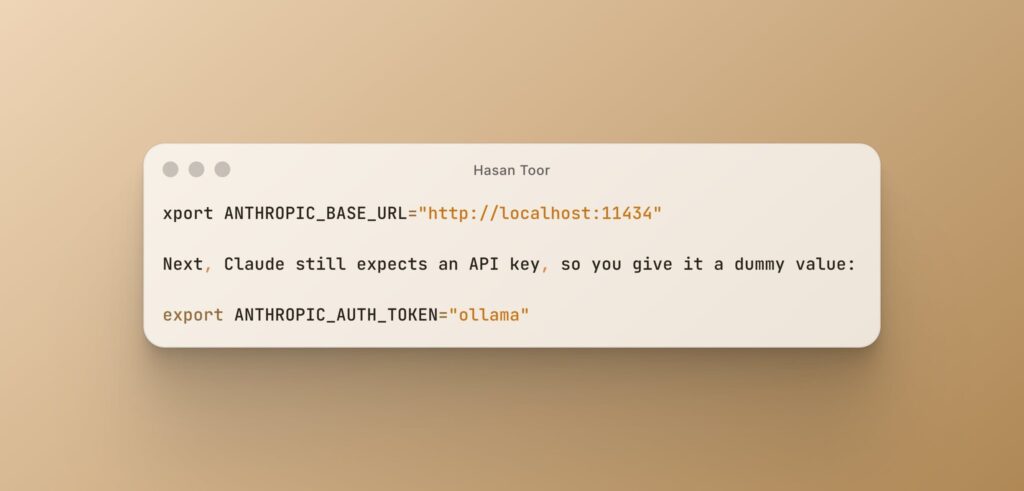

الخطوة 3: ربط Claude بجهازك

افتراضيًا، Claude يتصل بخوادم خارجية. في هذا الإعداد، يتم تحويله للعمل محليًا.

- قم بتحديد عنوان الـ Base URL ليشير إلى جهازك

- هذا يجعل Claude يستخدم Ollama بدلًا من الإنترنت

النتيجة:

Claude يصبح واجهة محلية بالكامل تعمل على جهازك فقط

الخطوة 4: تشغيل Claude وتجربته

الآن يمكن استخدام Claude Code فعليًا:

- انتقل إلى أي مجلد مشروع على جهازك

- قم بتشغيل Claude باستخدام النموذج الذي اخترته

مثال للاستخدام:

- طلب إنشاء موقع بسيط مثل:

“Make a hello world website”

ما سيحدث:

- يقوم بتحليل ملفاتك

- يكتب ويعدل الكود

- ينفذ المهام مباشرة على جهازك

النتيجة

- لا حاجة للإنترنت

- لا توجد تكاليف API

- لا حدود استخدام

- كل شيء يعمل محليًا بخصوصية كاملة